Un recente studio evidenzia rischi legali ed etici per i medici che usano IA, aggravando burnout e incertezza.

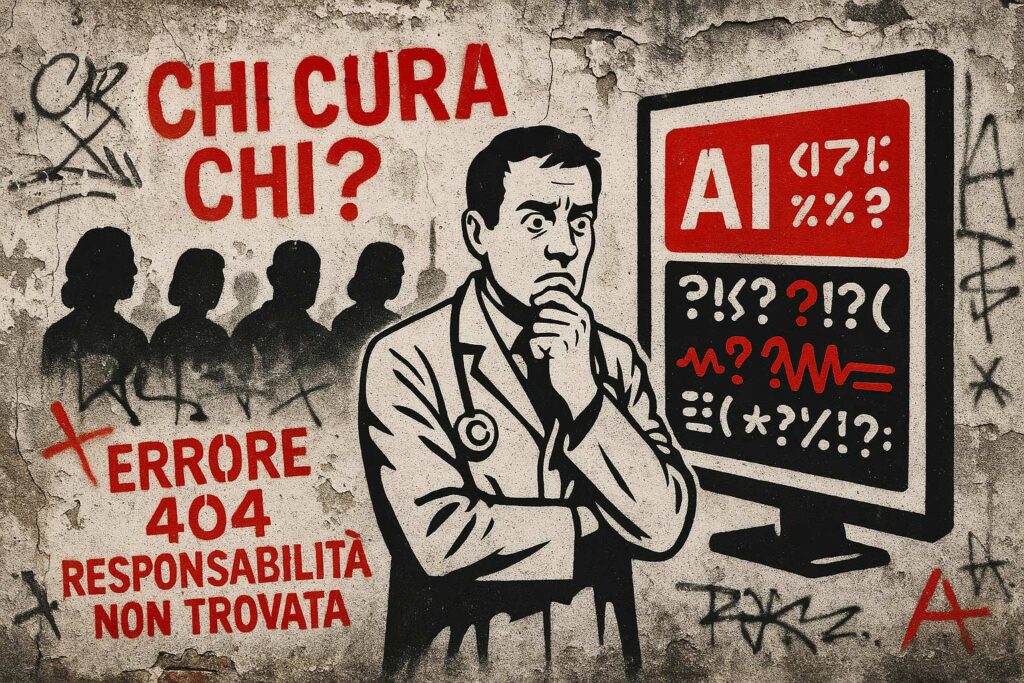

Le tecnologie di intelligenza artificiale assistiva stanno trasformando l’assistenza sanitaria, offrendo supporto nella diagnosi e nel trattamento dei pazienti. Tuttavia, un nuovo rapporto pubblicato sul JAMA Health Forum solleva dubbi importanti: chi è responsabile in caso di errore?

Lo studio, condotto da ricercatori della Johns Hopkins Carey Business School, Johns Hopkins Medicine e University of Texas McCombs School of Business, avverte che l’attuale uso dell’IA rischia di aumentare gli errori e il burnout tra i medici.

Secondo Shefali Patil, docente della University of Texas, le aspettative nei confronti dei medici sono diventate irrealistiche: si presume che debbano saper valutare quando fidarsi o meno dell’IA, una tecnologia che spesso rimane opaca persino ai suoi sviluppatori.

In assenza di regolamenti chiari, i medici si ritrovano a prendere decisioni critiche con strumenti non sempre trasparenti, temendo ricadute legali. Christopher Myers, docente della Carey Business School, paragona la situazione a “pilotare un aereo che si è anche progettato”, chiedendo sistemi di supporto strutturati.

Gli esperti raccomandano un approccio organizzativo all’apprendimento, che sposti il focus dalle responsabilità individuali alla collaborazione tra medici e istituzioni. In gioco non c’è solo l’efficienza, ma la sicurezza dei pazienti.

Pro e rischi etici e sociali

Pro: Maggiore supporto diagnostico, potenziale riduzione degli errori umani.

Rischi: Burnout, delega non consapevole, responsabilità legale incerta, trasparenza assente.

Fonti

- JAMA Health Forum

- University of Texas at Austin McCombs School of Business

- Johns Hopkins Carey Business School

Approfondimenti