Anche i sistemi più avanzati non possono proteggere dalla vulnerabilità umana

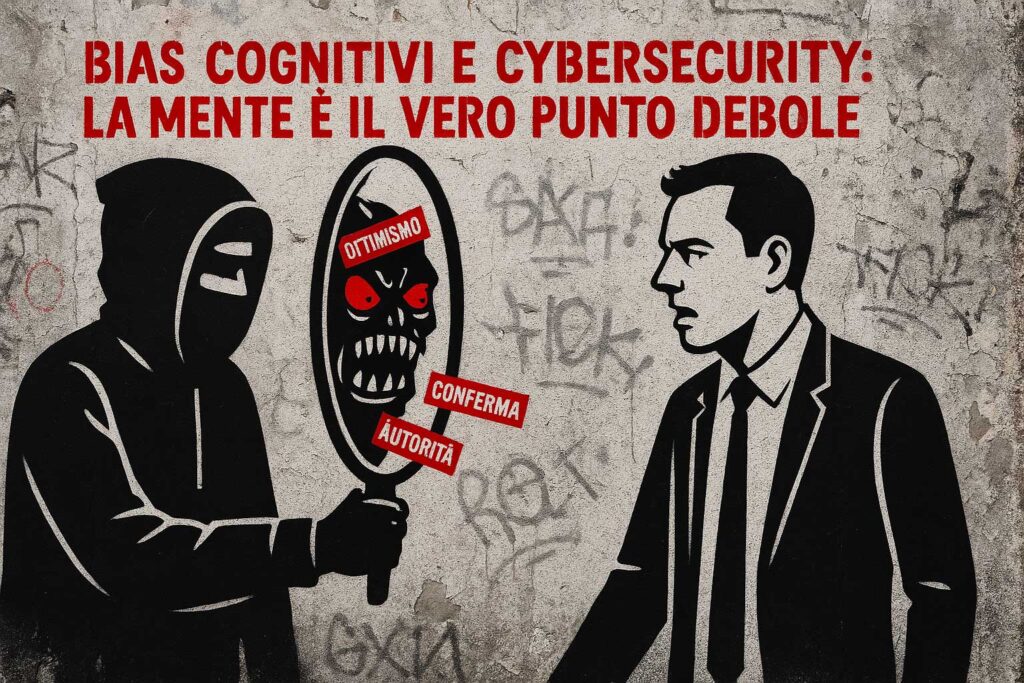

Nel panorama della sicurezza informatica, spesso ci si concentra sulle tecnologie: firewall, antivirus, intelligenza artificiale. Ma la vera vulnerabilità risiede nella mente umana, minata dai bias cognitivi, distorsioni mentali che influenzano le nostre decisioni.

I bias cognitivi sono scorciatoie del pensiero, utili in alcuni contesti, ma pericolose in altri. Nella cybersecurity, possono rappresentare un rischio critico. Il bias di autorità, ad esempio, può indurre un dipendente a eseguire ordini apparentemente legittimi ma falsi. Il bias di ottimismo porta a sottovalutare i rischi informatici. Il bias di conferma può spingerci ad accettare solo le informazioni che confermano le nostre convinzioni, ignorando segnali d’allarme.

Secondo l’ENISA (Agenzia dell’Unione Europea per la Cybersecurity), l’errore umano è tra le principali cause di violazione dei dati. Per contrastare questi rischi, servono strategie efficaci: formazione continua, simulazioni di attacchi (phishing simulation), cultura della sicurezza condivisa e uso del principio del minimo privilegio.

Il vero cambiamento parte dalla comprensione di sé: riconoscere i propri bias è il primo passo per rafforzare le difese informatiche.

In un’era dominata dall’AI e dalla tecnologia, proteggersi significa prima di tutto conoscere il nemico interiore. Perché la minaccia più insidiosa non è un virus, ma un errore di giudizio.

Fonti affidabili:

- ENISA, Cybersecurity Threat Landscape 2023 – https://www.enisa.europa.eu

- NIST, Human Factors in Cybersecurity – https://www.nist.gov

- RHC Conference – https://www.redhotcyber.com

Consigli di approfondimento:

- Dark Mirror: il report sul ransomware di Dark Lab

- Bias cognitivi e sicurezza secondo NIST