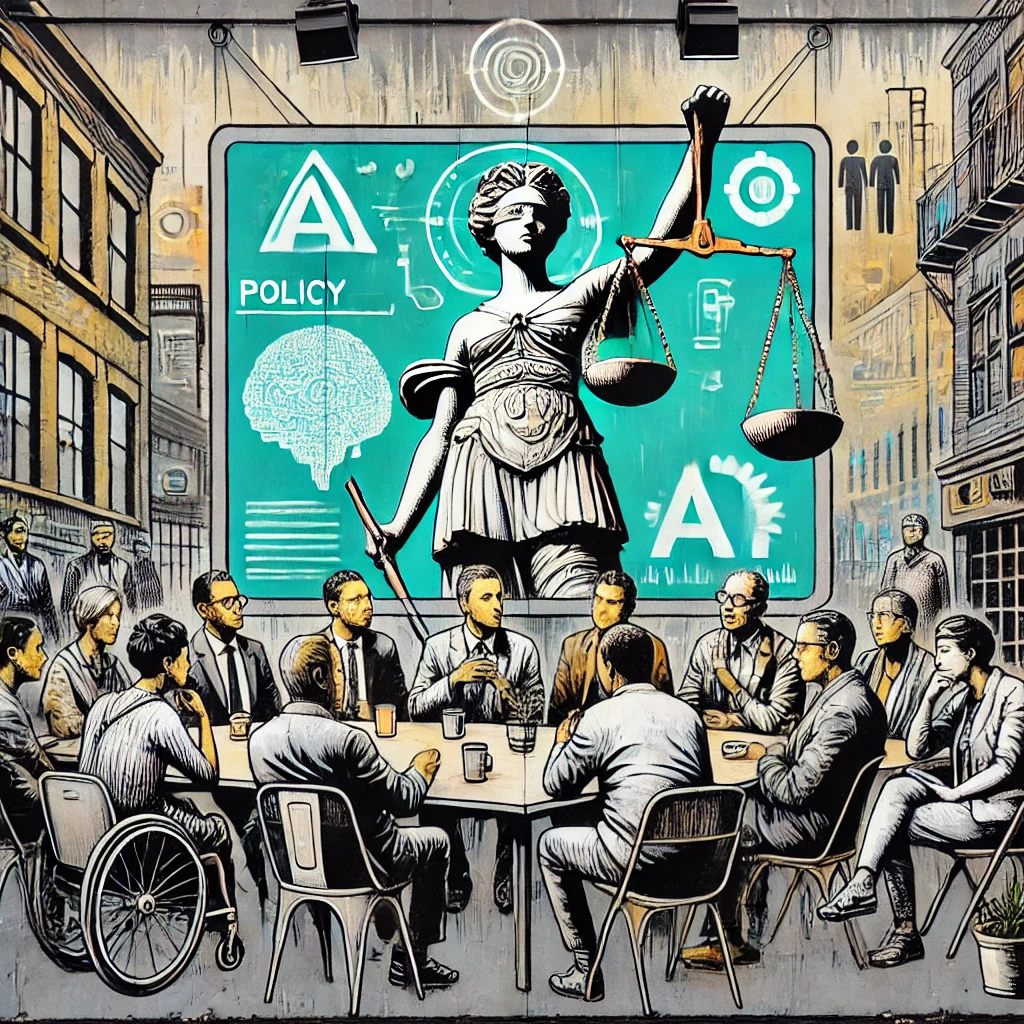

Un quadro per la governance dell’AI avanzata

Il California Policy Working Group on AI Frontier Models ha pubblicato un rapporto preliminare con linee guida per la governance dell’intelligenza artificiale avanzata. Il documento, richiesto dal governatore Gavin Newsom, mira a bilanciare innovazione e sicurezza, fornendo principi chiave per regolamentare l’AI senza ostacolare il progresso tecnologico.

Principi chiave per la regolamentazione dell’AI

Il rapporto evidenzia otto principi fondamentali per la governance dell’AI avanzata:

- Bilanciare benefici e rischi: promuovere l’innovazione riducendo i potenziali pericoli.

- Policymaking basato su evidenze: sfruttare dati e analisi rigorose per decisioni informate.

- Scelte iniziali strategiche: le prime decisioni tecnologiche e normative influenzano lo sviluppo futuro.

- Allineare incentivi: coinvolgere il settore privato garantendo trasparenza e sicurezza.

- Migliorare la trasparenza: ridurre l’opacità nel settore AI per aumentare la fiducia pubblica.

- Protezione dei whistleblower e valutazioni indipendenti: strumenti essenziali per garantire accountability.

- Monitoraggio post-deployment: sistemi di segnalazione per eventi avversi e aggiornamenti normativi.

- Definire soglie di intervento: stabilire parametri chiari per regolamentare l’AI in base a impatti e costi computazionali.

Verso una governance efficace

Il rapporto sottolinea la necessità di collaborazioni interdisciplinari e feedback pubblico. Le istituzioni e i cittadini possono contribuire entro l’8 aprile 2025, con il documento finale previsto per giugno 2025. L’iniziativa rappresenta un passo cruciale per un uso responsabile dell’AI in California e oltre.

Fonti:

📌 California Frontier AI Policy Working Group

📌 Stanford HAI

📌 UC Berkeley Computing, Data Science, and Society